Regulamentar a IA generativa: em que mundo queremos viver? O que podemos mas não devemos fazer?

Giovanni Ramos (em representação da ESEC), João Figueira (representando o sinalAberto), Sylvia Debossan Moretzsohn (co-autora da obra apresentada na Casa Municipal da Cultura de Coimbra) e Maria Inácia Rezola (autora do posfácio). (© VJS – sinalAberto)

O debate decorrente da apresentação do livro “60 Anos do Golpe, 50 Anos da Revolução – Democracia em Disputa em Brasil e Portugal”, promovido pelo jornal sinalAberto, em parceria com a Escola Superior de Educação de Coimbra, no dia 3 de março, na Casa Municipal da Cultura de Coimbra, acabou concentrando-se numa questão que a obra apenas tangencia, mas é incontornável: o desenvolvimento da chamada inteligência artificial (IA) generativa e os seus efeitos na nossa vida quotidiana e no nosso futuro como espécie.

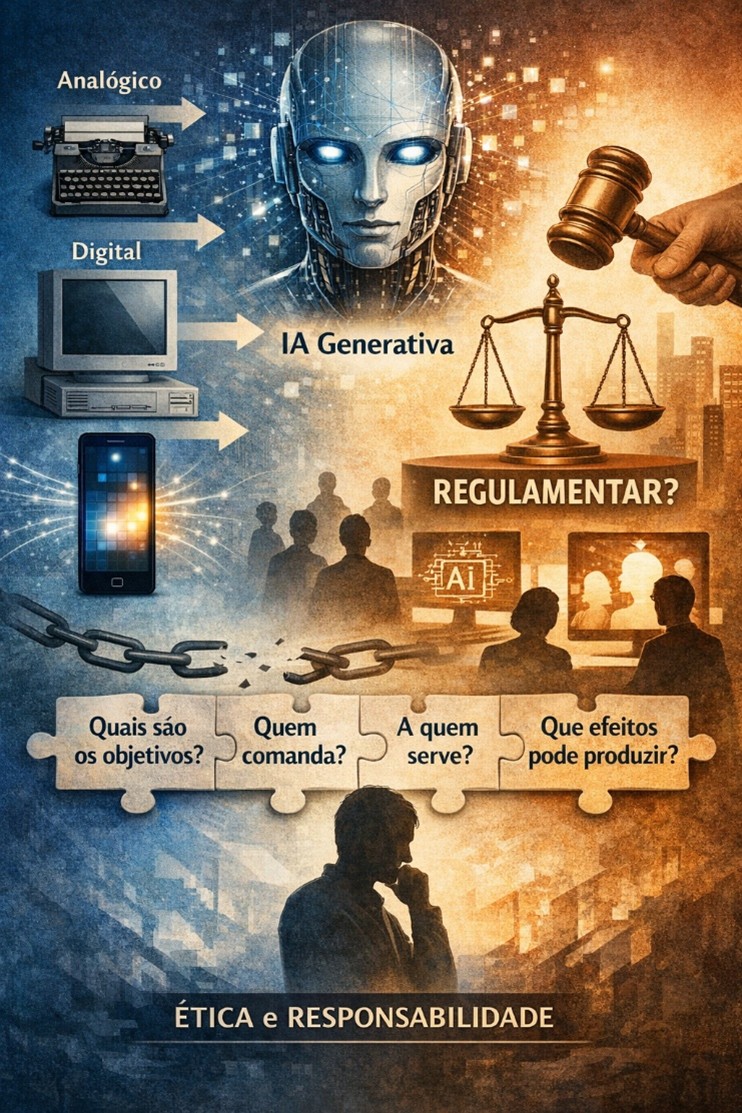

Duas questões fundamentais surgiram em torno desse tema. A primeira partiu da recorrente comparação com situações anteriores de mudanças tecnológicas: se passamos do analógico para o digital, da máquina de escrever para o computador, do telefone fixo para o telemóvel e suas múltiplas funcionalidades, não seria o caso de considerar os prós e os contras da IA generativa e de nos adaptarmos a ela, combatendo os riscos e aproveitando o que ela nos oferece de positivo? A segunda decorre da primeira: em vez de demonizar, não seria o caso de regulamentar essa nova tecnologia, para impedir ou, pelo menos, limitar os danos que vem provocando?

A resposta à primeira questão envolve, de saída, a necessidade de se romper com a naturalização de um determinado tipo de desenvolvimento tecnológico, como se ele fosse inevitável, e que sempre nos é apresentado como avanço científico – portanto, inquestionável: quais são os seus objetivos? Quem os comanda? A quem serve? Que efeitos pode produzir? Toda a pesquisa científica deveria estar obrigada a responder à elementar pergunta ética sobre a sua finalidade e os seus procedimentos.

É claro que a automação de tarefas repetitivas e enfadonhas deveria ser comemorada como libertação do trabalho alienado, para citarmos uma conhecida, e fundamental, embora frequentemente ignorada, categorização marxista. Mas essa libertação só poderia ocorrer se vivêssemos num sistema voltado para a emancipação humana. Como, pelo contrário, o sistema se baseia no aprofundamento da exploração do trabalho para a apropriação privada da riqueza socialmente produzida, o resultado da automação é a geração de um crescente contingente de marginalizados e de subempregados ao redor do Mundo, obrigados a lutar pela sobrevivência e a tentar preservar a esperança diante da engrenagem que os torna perfeitamente descartáveis.

Bem a propósito, o académico e jornalista João Figueira, apresentador da sessão, lembrou o que ocorreu com a informatização dos jornais: afinal, os jornalistas teriam mais tempo para pensar, pesquisar e elaborar as suas reportagens; poderiam aprofundar-se na investigação, etc. Ocorreu exatamente o contrário: a dispensa de profissionais, para reduzir custos; a sobrecarga dos que mantêm o emprego; a precarização da atividade e a decorrente queda de qualidade. O que, previsivelmente, acabou vitimando as próprias empresas jornalísticas, que utilizaram a nova tecnologia apenas no sentido da aceleração da produção que ela proporcionava, descurando o fundamental: a substância.

Mas o mais importante, no que diz respeito à IA generativa, é esclarecer sobre a sua natureza radicalmente distinta, que, por isso, não autoriza as analogias sempre mobilizadas quando se discute o desenvolvimento tecnológico: o que está em causa, agora, é a delegação de tarefas intelectuais aos robôs e a aceitação acrítica do que eles produzem, que levam à corrosão da capacidade de pensar.

O neurocientista brasileiro Miguel Nicolelis tem insistido nesse ponto. Numa entrevista ao programa Roda Viva, da TV Cultura, de São Paulo, em julho do ano passado, argumentou: “Quando a gente começa a subcontratar a nossa mente para um sistema digital e toda dúvida que você tem vai perguntar para o Grok ou o Google, o cérebro, como consome 20% da energia que nós produzimos, vai dizer: opa, não preciso mais consumir energia para pensar. E começa a subcontratar. E começa a esquecer. Começa a esquecer a forma de raciocinar.”

do Projeto Andar de Novo, em maio de 2014. (pt.wikipedia.org)

Se isso afeta mesmo as pessoas mais experientes e bem formadas, que dirá quem está chegando agora e já nasce deslizando o dedo no ecrã do telemóvel.

Por isso, não cabe argumentar com a nossa capacidade de discernimento, que nos permitiria um uso consciente e crítico da nova tecnologia: porque, mesmo que isso ocorresse – e frequentemente não ocorre, tantas são as informações falsas que acabamos compartilhando, porque agimos impulsivamente e aderimos ao que confirma as nossas convicções –, os mais novos, já criados nesse ambiente, não teriam essa formação.

Some-se a isso a sofisticação cada vez maior dos produtos da IA generativa, que torna indistinguível o verdadeiro do falso e que contribui para criar um ambiente de permanente incerteza quanto àquilo em que se pode acreditar. Pensemos nos vídeos que expõem cenas chocantes ou “denunciam” comportamentos aberrantes, ou nos que circulam em momentos de grande tensão, como os da atual repressão do governo norte-americano aos imigrantes ou o do bombardeio ao Irão: são verdade? São feitos por IA?

inteligência artificial generativa, descontrolada como está – ou

controlada pelas big techs, como está – pode levar a um nível inédito de

alienação […]” (© VJS – sinalAberto)

Pensemos também no que vem ocorrendo no meio académico, no recurso a essa tecnologia para gerar pesquisas que embaralham fontes verdadeiras e inventadas, e que acabam acolhidas como se fosse produção própria, dada a pressão produtivista que trata os investigadores como hamsters na sua corrida alucinada na roda que não sai do lugar: para quê empenhar-se em gastar tempo e massa cinzenta para produzir uma reflexão própria e original, se tudo pode resolver-se com um clique? Quem poderá asseverar a legitimidade da autoria ou a fidedignidade das informações?

Por isso, na parte final de meu artigo sobre desinformação, que compõe o livro apresentado na Casa Municipal da Cultura de Coimbra, escrevi o seguinte: “[…] o desenvolvimento da chamada inteligência artificial generativa, descontrolada como está – ou controlada pelas big techs, como está – pode levar a um nível inédito de alienação, ao jogar para robôs a produção de textos acad[é]micos ou a resposta a pesquisas elementares do [qu]otidiano, como por exemplo as relativas à saúde. Não é preciso muito esforço para pensar no que pode ocorrer no futuro imediato, com as novas gerações sendo assim deformadas, sem qualquer condição de avaliar a qualidade das informações e provavelmente sem qualquer preocupação com isso. Como é possível tamanha servidão voluntária? Como é possível abrirmos mão daquilo que mais deveríamos perseguir, porque é o que nos distingue como humanos: a nossa autonomia intelectual, a nossa capacidade de raciocinar, de refletir, de pensar por nós mesmos? Como é possível atribuir à palavra ‘aut[ó]nomo’ um significado que não diz respeito a uma criação original nossa, mas a uma produção da máquina? Que tipo de referências teremos a partir de então?”

É claro que não se trata de demonizar esta ou qualquer outra tecnologia, mas de perceber como ela se desenvolve e quem a comanda. Portanto, sim, é absolutamente central regulamentá-la. Porém, isso implica uma luta política crucial, porque exige a auditoria dos algoritmos, que as “big techs” nunca permitiram. E que, como mostrou Joana Gonçalves de Sá, em recente entrevista ao “podcast” “Perguntar Não Ofende”, induzem ao voto em partidos de extrema-direita.

No mesmo programa, a investigadora defendeu a urgência dessa regulação, diante do impacto dessa tecnologia em todos os aspectos da nossa vida, inclusive na saúde mental. Investir em educação não basta: como argumentou Joana de Sá, seria como instruir as pessoas a terem cuidado na hora de consumir alguma medicação, num ambiente em que a produção de remédios fosse liberada, sem autorização prévia ou fiscalização. Como, então, franquear o mercado às redes sociais e aos “chatbots”, sem qualquer tipo de escrutínio?

Uma hipótese de regulação é impedir que os “chatbots” respondam a perguntas sobre a orientação do voto. Ou que os algoritmos sejam definidos não para estimular, mas para reprimir os discursos de ódio. Tudo isso é fundamental, mas o principal é bloquear o impulso da nossa tendência a fetichizar a tecnologia e a nos relacionarmos com os robôs como se fossem humanos, de modo a não lhes delegar a nossa capacidade intelectual. Isso envolve muita coisa que não dá para desenvolver neste artigo, mas que indica a necessidade – de novo, ética – de submeter o desenvolvimento tecnológico às questões que deveriam orientar todas as demais: em que mundo pretendemos viver? O que podemos mas não devemos fazer? É nessa perspectiva, a da emancipação humana, que se insere esta luta.

.

09/03/2026